配置火山引擎

火山引擎是位元組跳動旗下的雲服務平臺,提供豆包大模型(Doubao)系列服務。支援文字生成、對話理解、內容創作等功能,具備高併發、低延遲的企業級服務能力。

1. 獲取火山引擎 API Key

1.1 訪問火山引擎控制檯

訪問火山引擎並登入:https://console.volcengine.com/

1.2 開通豆包大模型服務

- 在搜尋框中輸入 火山方舟

- 點選 豆包大模型

- 點選 立即開通

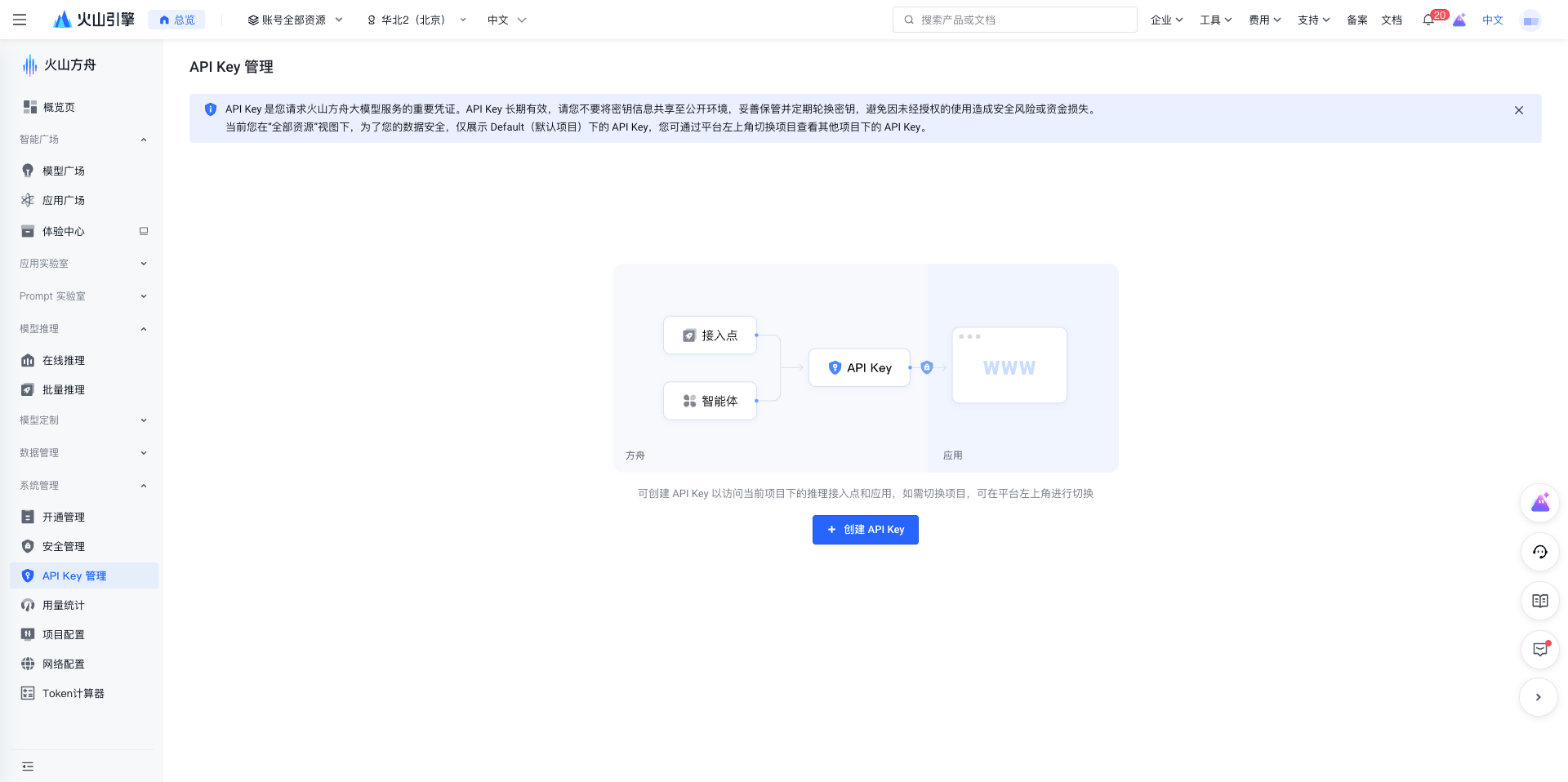

1.3 API Key 管理

- 點選左側選單的 API 訪問 或 金鑰管理

- 進入 API Key 管理頁面

1.4 建立 API Key

- 點選 建立 API Key 按鈕

- 輸入 API Key 名稱

- 點選 確定

1.5 獲取 API Key

建立成功後,系統會顯示 API Key。

重要:請立即複製並妥善儲存,API Key 為 UUID 格式。

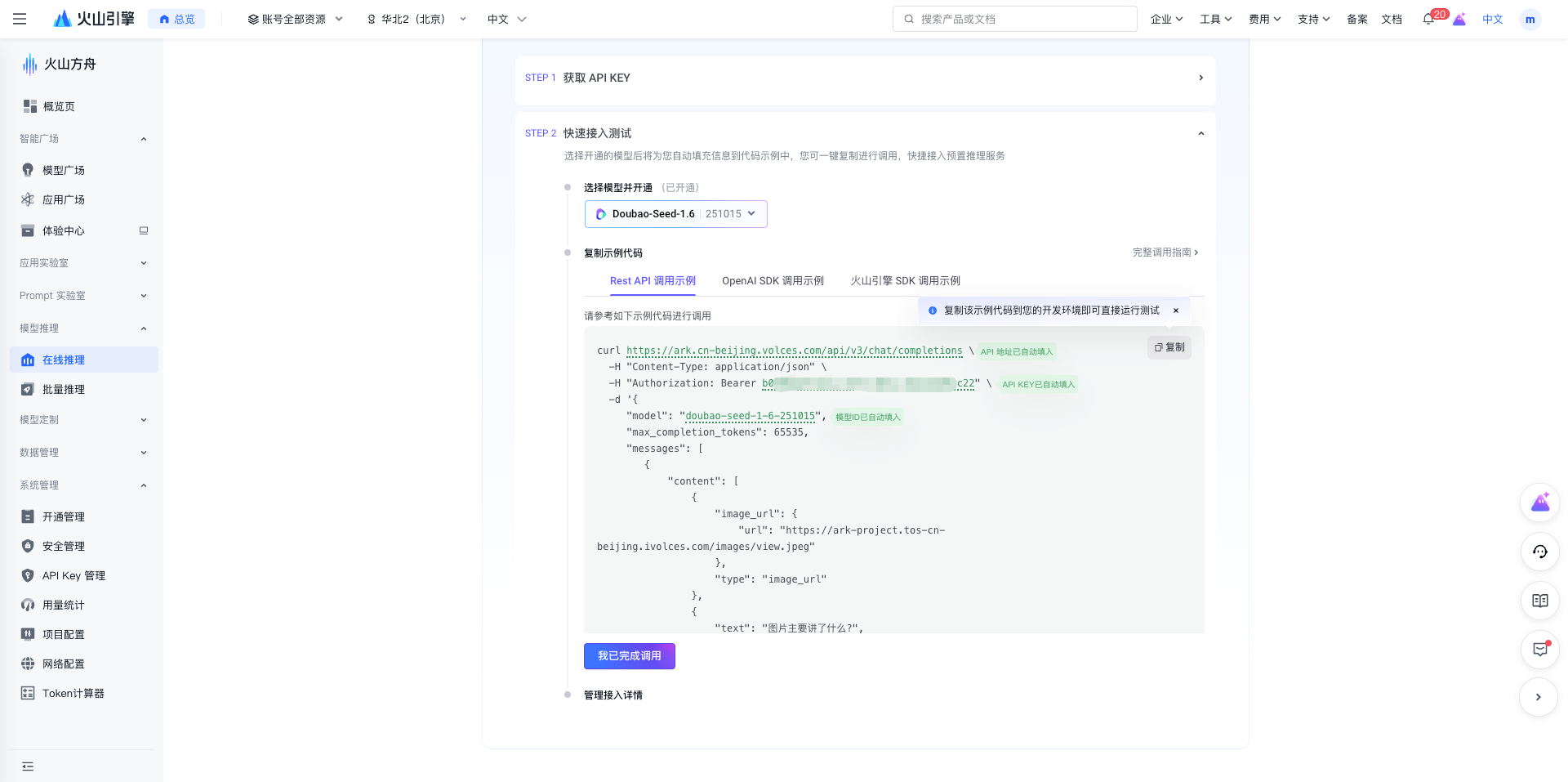

1.6 開通線上推理模型

重要:在使用火山引擎模型之前,必須先開通對應的模型服務,否則 API 呼叫時會報錯 "InvalidEndpointOrModel.NotFound"。

- 在火山方舟控制檯左側選單,點選 線上推理 → 預置推理接入點

- 選擇要使用的模型(如

Doubao-Seed-1.6),勾選開通協議,點選 開通模型 按鈕

開通成功後,就可以在 CueMate 中使用該模型名稱。

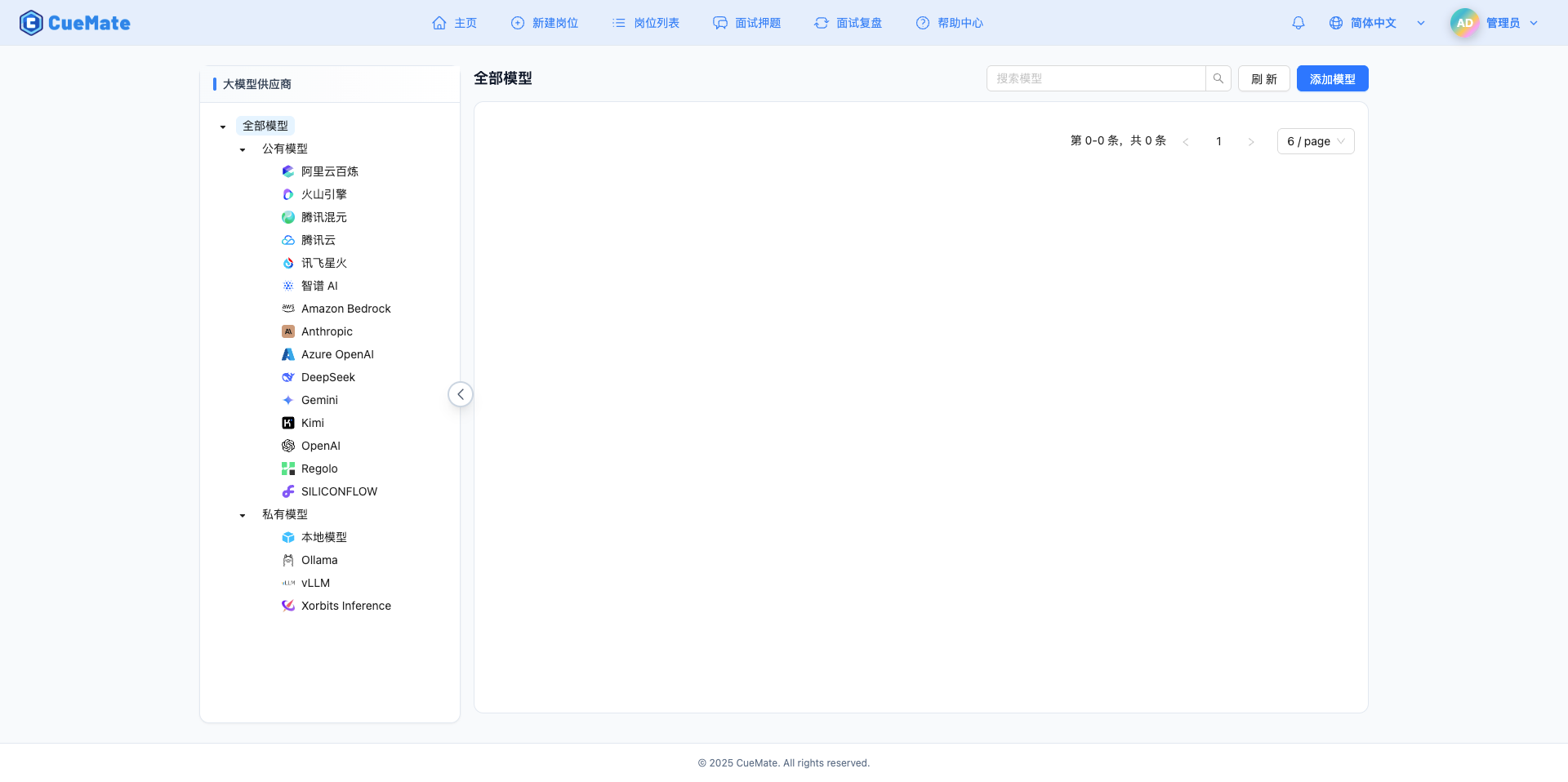

2. 在 CueMate 中配置火山引擎模型

2.1 進入模型設定頁面

登入 CueMate 系統後,點選右上角下拉選單的 模型設定。

2.2 新增新模型

點選右上角的 新增模型 按鈕。

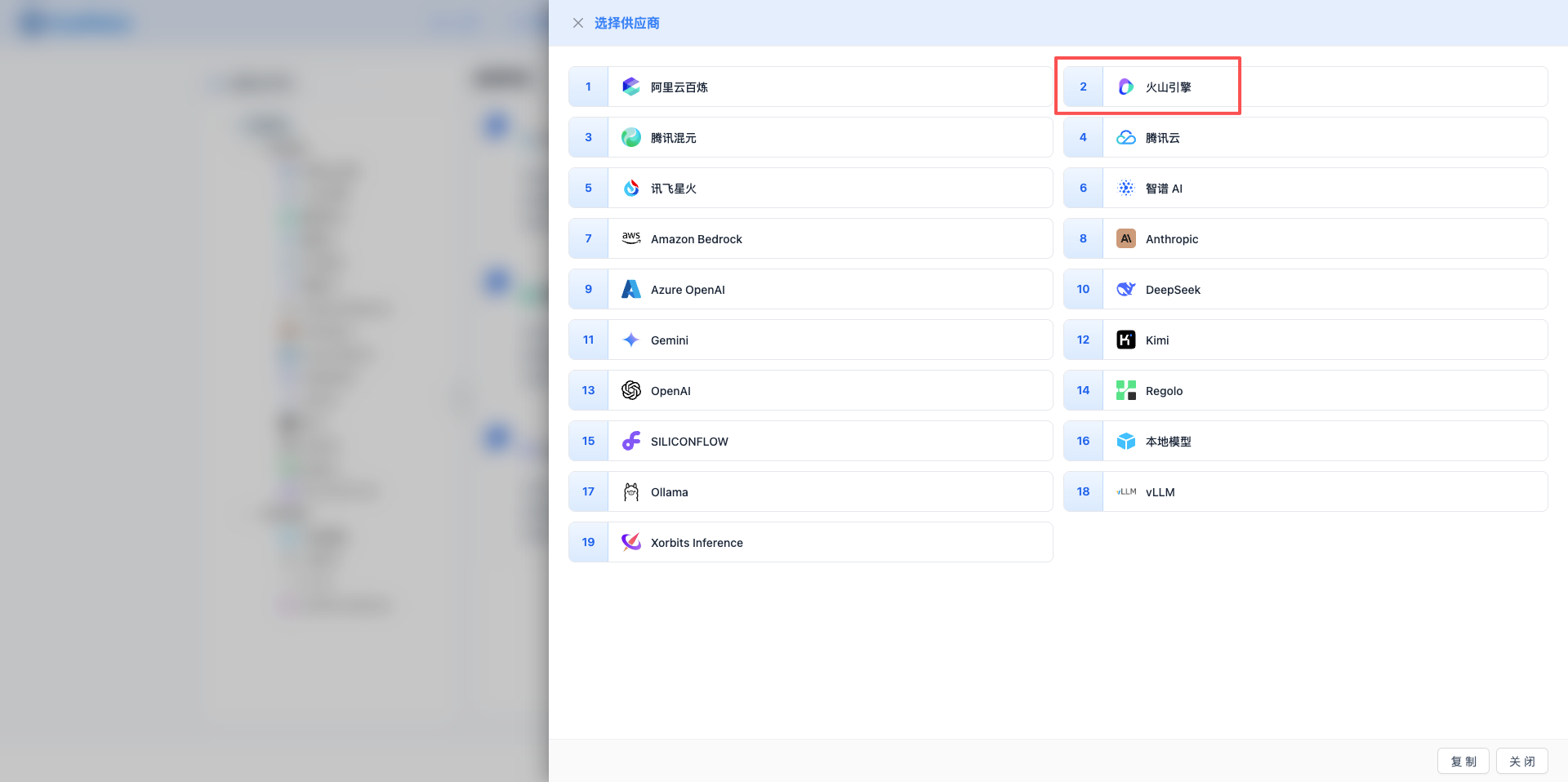

2.3 選擇火山引擎服務商

在彈出的對話方塊中:

- 服務商型別:選擇 火山引擎

- 點選後 自動進入下一步

2.4 填寫配置資訊

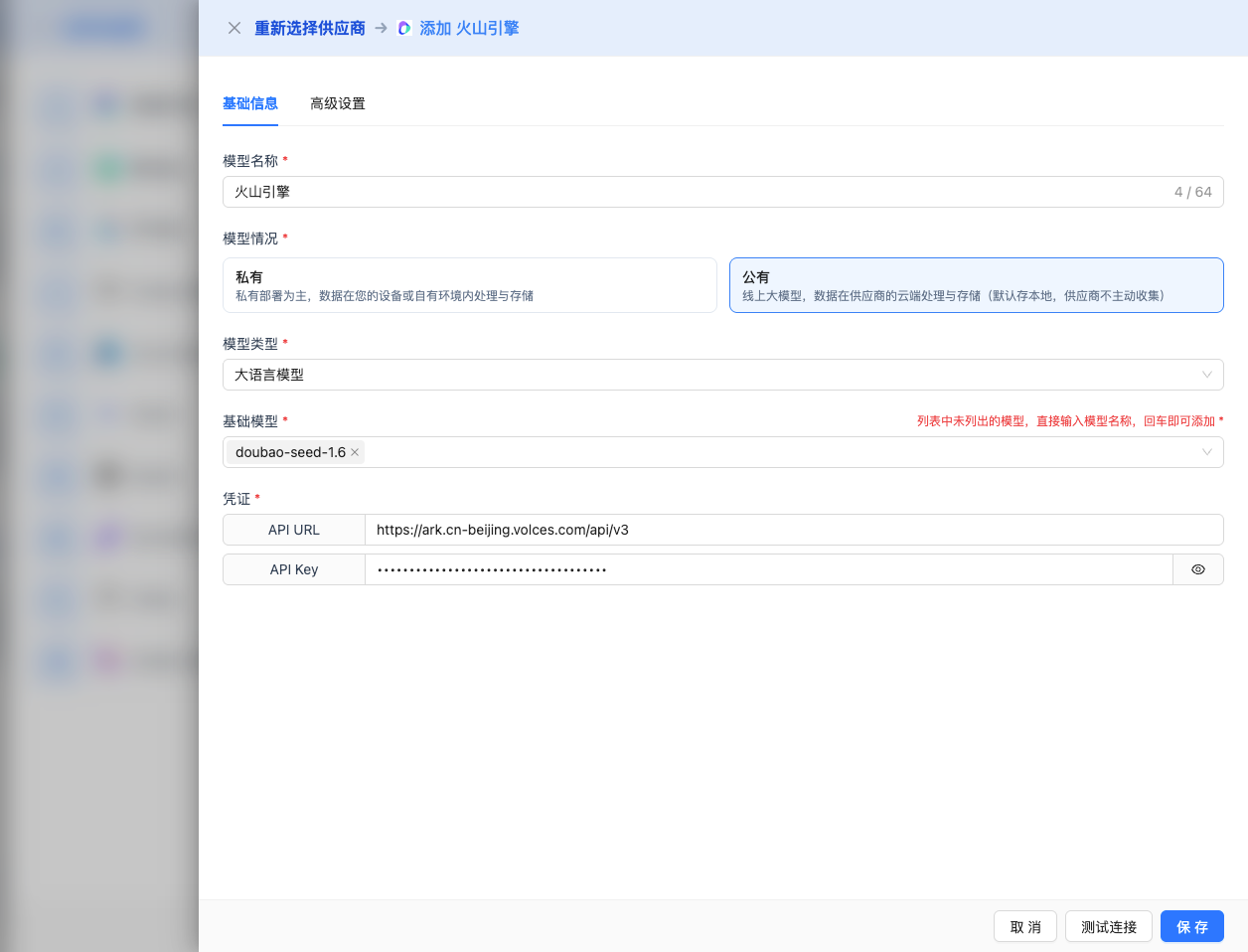

在配置頁面填寫以下資訊:

基礎配置

- 模型名稱:為這個模型配置起個名字(例如:豆包 Seed 1.6)

- API URL:保持預設

https://ark.cn-beijing.volces.com/api/v3 - API Key:貼上火山引擎的 API Key(UUID 格式)

- 模型版本:填寫在步驟 1.6 中開通的模型對應的 API 名稱

- 重要:需要使用 API 格式的模型名稱(如

doubao-seed-1-6-251015),不是控制檯顯示的名稱 - 也可使用推理接入點 ID(如

ep-xxxxxxxxxx-yyyy)

- 重要:需要使用 API 格式的模型名稱(如

模型名稱格式說明:

- 控制檯顯示:

Doubao-Seed-1.6(日期 251015) - API 呼叫格式:

doubao-seed-1-6-251015(全小寫,點號改為連字元,末尾加日期)

可用的 2026 最新模型(需先在步驟 1.6 中開通,下方為 API 格式名稱):

doubao-seed-1-6-251015:豆包 Seed 1.6(256K 上下文,16K 輸出)doubao-seed-1-6-thinking-250715:豆包 Seed 1.6 思維模型doubao-seed-1-6-flash-250828:豆包 Seed 1.6 超快版doubao-seed-1-6-vision-250815:豆包 Seed 1.6 多模態版(64K 輸出)doubao-1-5-thinking-pro-250415:豆包 1.5 思維增強版(16K 輸出)doubao-1-5-vision-pro-250328:豆包 1.5 多模態版(16K 輸出)doubao-1-5-ui-tars-250428:豆包 1.5 UI-TARS(16K 輸出)doubao-1-5-pro-32k-250115:豆包 1.5 Pro 32K 版本(4K 輸出)doubao-1-5-pro-256k-250115:豆包 1.5 Pro 256K 版本(4K 輸出)doubao-1-5-lite-32k-250115:豆包 1.5 輕量版(4K 輸出)deepseek-v3-1-terminus:DeepSeek V3.1 Terminus(8K 輸出)deepseek-r1-250528:DeepSeek R1(8K 輸出)deepseek-v3-250324:DeepSeek V3(8K 輸出)kimi-k2-250905:Kimi K2(4K 輸出)

注意:模型名稱必須使用 API 格式(全小寫、連字元、帶日期字尾),否則會報錯 "InvalidEndpointOrModel.NotFound"。

高階配置(可選)

展開 高階配置 面板,可以調整以下引數:

CueMate 介面可調引數:

溫度(temperature):控制輸出隨機性

- 範圍:0-2

- 推薦值:0.7

- 作用:值越高輸出越隨機創新,值越低輸出越穩定保守

- 使用建議:

- 創意寫作/頭腦風暴:1.0-1.5

- 常規對話/問答:0.7-0.9

- 程式碼生成/精確任務:0.3-0.5

輸出最大 tokens(max_tokens):限制單次輸出長度

- 範圍:256 - 64000(根據模型而定)

- 推薦值:8192

- 作用:控制模型單次響應的最大字數

- 模型限制:

- doubao-seed-1-6-vision:最大 64K tokens

- doubao-seed-1-6 系列:最大 16K tokens

- doubao-1-5 系列:最大 16K tokens

- Pro/Lite 系列:最大 4K tokens

- deepseek/kimi 系列:最大 8K tokens

- 使用建議:

- 簡短問答:1024-2048

- 常規對話:4096-8192

- 長文生成:16384-32768

- 超長輸出:65536(僅 vision 模型)

火山引擎 API 支援的其他高階引數:

雖然 CueMate 介面只提供 temperature 和 max_tokens 調整,但如果你透過 API 直接呼叫火山引擎,還可以使用以下高階引數(火山引擎採用 OpenAI 相容的 API 格式):

top_p(nucleus sampling)

- 範圍:0-1

- 預設值:1

- 作用:從機率累積達到 p 的最小候選集中取樣

- 與 temperature 的關係:通常只調整其中一個

- 使用建議:

- 保持多樣性但避免離譜:0.9-0.95

- 更保守的輸出:0.7-0.8

frequency_penalty(頻率懲罰)

- 範圍:-2.0 到 2.0

- 預設值:0

- 作用:降低重複相同詞彙的機率(基於詞頻)

- 使用建議:

- 減少重複:0.3-0.8

- 允許重複:0(預設)

presence_penalty(存在懲罰)

- 範圍:-2.0 到 2.0

- 預設值:0

- 作用:降低已出現過的詞彙再次出現的機率(基於是否出現)

- 使用建議:

- 鼓勵新話題:0.3-0.8

- 允許重複話題:0(預設)

stop(停止序列)

- 型別:字串或陣列

- 預設值:null

- 作用:當生成內容包含指定字串時停止

- 示例:

["###", "使用者:", "\n\n"] - 使用場景:

- 結構化輸出:使用分隔符控制格式

- 對話系統:防止模型代替使用者說話

stream(流式輸出)

- 型別:布林值

- 預設值:false

- 作用:啟用 SSE 流式返回,邊生成邊返回

- CueMate 中:自動處理,無需手動設定

| 序號 | 場景 | temperature | max_tokens | top_p | frequency_penalty | presence_penalty |

|---|---|---|---|---|---|---|

| 1 | 創意寫作 | 1.0-1.2 | 4096-8192 | 0.95 | 0.5 | 0.5 |

| 2 | 程式碼生成 | 0.2-0.5 | 2048-4096 | 0.9 | 0.0 | 0.0 |

| 3 | 問答系統 | 0.7 | 1024-2048 | 0.9 | 0.0 | 0.0 |

| 4 | 摘要總結 | 0.3-0.5 | 512-1024 | 0.9 | 0.0 | 0.0 |

| 5 | 長文字生成 | 0.7 | 16384-32768 | 0.9 | 0.0 | 0.0 |

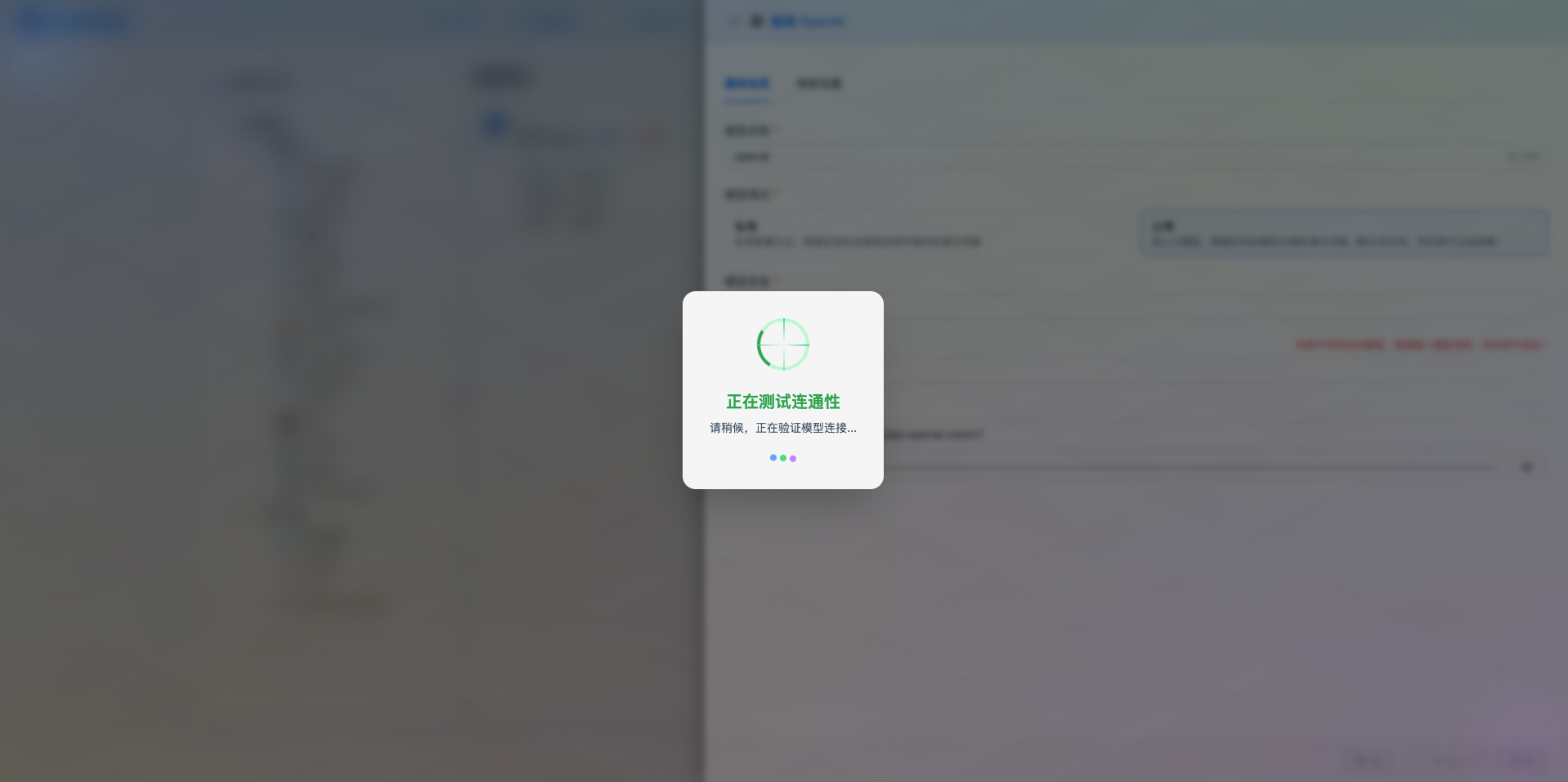

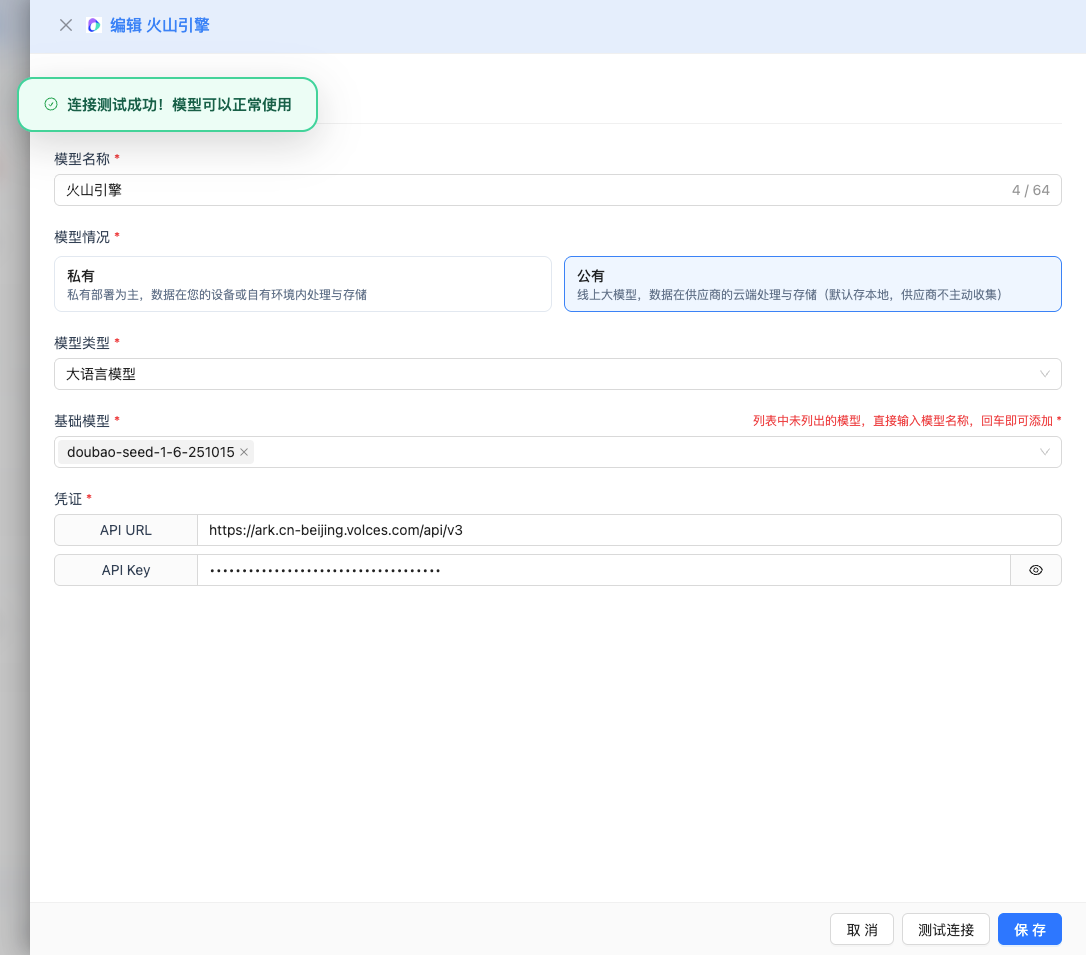

2.5 測試連線

填寫完配置後,點選 測試連線 按鈕,驗證配置是否正確。

如果配置正確,會顯示測試成功的提示,並返回模型的響應示例。

常見錯誤:

- 如果提示 "InvalidEndpointOrModel.NotFound",說明模型未開通或模型名稱不正確,請返回步驟 1.6 開通模型服務。

2.6 儲存配置

測試成功後,點選 儲存 按鈕,完成模型配置。

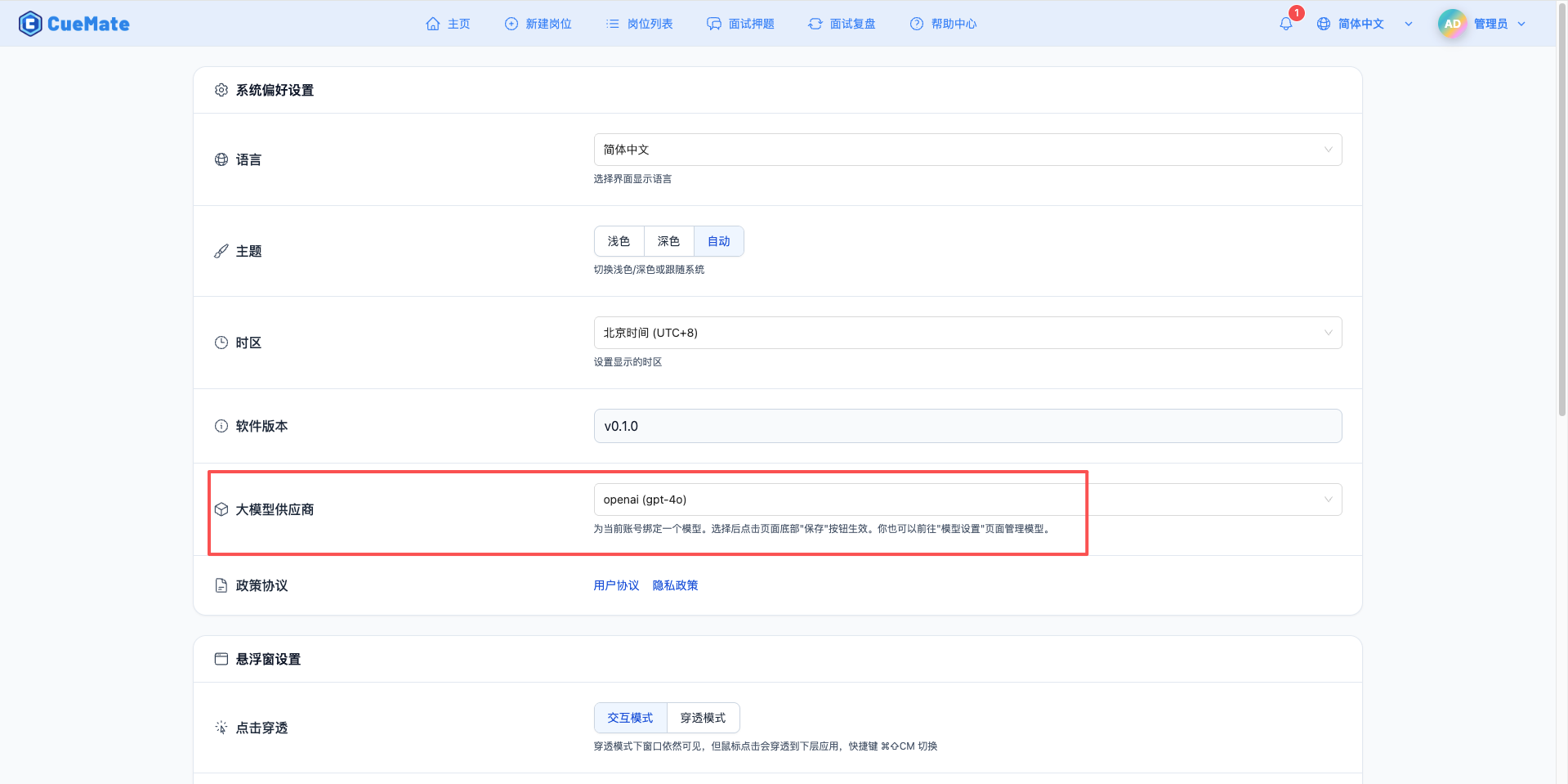

3. 使用模型

透過右上角下拉選單,進入系統設定介面,在大模型服務商欄目選擇想要使用的模型配置。

配置完成後,可以在面試訓練、問題生成等功能中選擇使用此模型, 當然也可以在面試的選項中單此選擇此次面試的模型配置。

4. 支援的模型列表

4.1 豆包 Seed 1.6 系列(2026 年最新)

| 序號 | 模型名稱 | API 呼叫名稱 | 上下文長度 | 最大輸出 | 適用場景 |

|---|---|---|---|---|---|

| 1 | 豆包 Seed 1.6 | doubao-seed-1-6-251015 | 256K | 16K tokens | 最新旗艦,超長文件處理 |

| 2 | 豆包 Seed 1.6 思維版 | doubao-seed-1-6-thinking-250715 | 256K | 16K tokens | 複雜推理、技術面試 |

| 3 | 豆包 Seed 1.6 閃電版 | doubao-seed-1-6-flash-250828 | 256K | 16K tokens | 超快響應、實時互動 |

| 4 | 豆包 Seed 1.6 多模態版 | doubao-seed-1-6-vision-250815 | 256K | 64K tokens | 影象理解、多模態分析 |

4.2 豆包 1.5 系列

| 序號 | 模型名稱 | API 呼叫名稱 | 上下文長度 | 最大輸出 | 適用場景 |

|---|---|---|---|---|---|

| 1 | 豆包 1.5 思維增強版 | doubao-1-5-thinking-pro-250415 | 128K | 16K tokens | 深度推理、程式碼分析 |

| 2 | 豆包 1.5 多模態版 | doubao-1-5-vision-pro-250328 | 128K | 16K tokens | 影象理解、多模態 |

| 3 | 豆包 1.5 UI-TARS | doubao-1-5-ui-tars-250428 | 128K | 16K tokens | UI 互動、介面理解 |

| 4 | 豆包 1.5 Pro 32K | doubao-1-5-pro-32k-250115 | 32K | 4K tokens | 標準場景、高價效比 |

| 5 | 豆包 1.5 Pro 256K | doubao-1-5-pro-256k-250115 | 256K | 4K tokens | 超長文件處理 |

| 6 | 豆包 1.5 輕量版 | doubao-1-5-lite-32k-250115 | 32K | 4K tokens | 快速響應、低成本 |

4.3 DeepSeek 系列

| 序號 | 模型名稱 | API 呼叫名稱 | 上下文長度 | 最大輸出 | 適用場景 |

|---|---|---|---|---|---|

| 1 | DeepSeek V3.1 Terminus | deepseek-v3-1-terminus | - | 8K tokens | 程式碼生成、技術推理 |

| 2 | DeepSeek R1 | deepseek-r1-250528 | - | 8K tokens | 推理增強、複雜問題 |

| 3 | DeepSeek V3 | deepseek-v3-250324 | - | 8K tokens | 通用對話、程式碼輔助 |

4.4 其他模型

| 序號 | 模型名稱 | API 呼叫名稱 | 上下文長度 | 最大輸出 | 適用場景 |

|---|---|---|---|---|---|

| 1 | Kimi K2 | kimi-k2-250905 | - | 4K tokens | 快速響應、對話互動 |

5. 常見問題

5.1 接入點 ID 錯誤

現象:測試連線時提示接入點不存在

解決方案:

- 檢查接入點 ID 格式(應為 ep-xxxxxxxxxx-yyyy)

- 確認推理接入點已成功建立

- 驗證接入點狀態為"執行中"

5.2 API Key 無效

現象:提示 API Key 錯誤

解決方案:

- 檢查 API Key 是否為 UUID 格式

- 確認 API Key 未過期或被禁用

- 驗證 API Key 關聯的賬號有模型訪問許可權

5.3 請求超時

現象:測試連線或使用時長時間無響應

解決方案:

- 檢查網路連線是否正常

- 確認 API URL 配置正確

- 檢查防火牆設定

5.4 配額限制

現象:提示超出請求配額

解決方案:

- 登入火山引擎控制檯檢視配額使用情況

- 申請提高配額限制

- 最佳化使用頻率