配置 Google Gemini

Google Gemini 是 Google 開發的多模態 AI 模型系列,支援文字、影象、音訊等多種輸入形式。提供從輕量級到旗艦級的多層次模型選擇,具備強大的推理、分析和創作能力。

1. 獲取 Google Gemini API Key

1.1 訪問 AI Studio

訪問 AI Studio 並登入:https://aistudio.google.com/

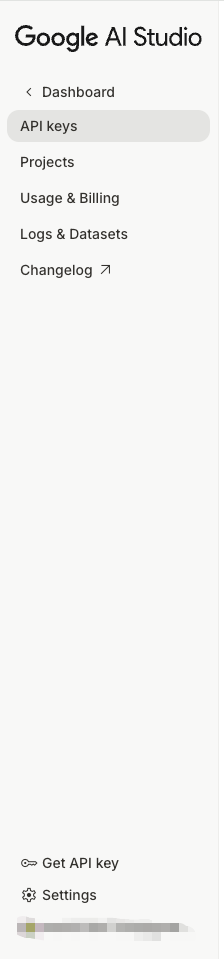

1.2 進入 API Keys 頁面

登入後,點選左側選單的 Get API key。

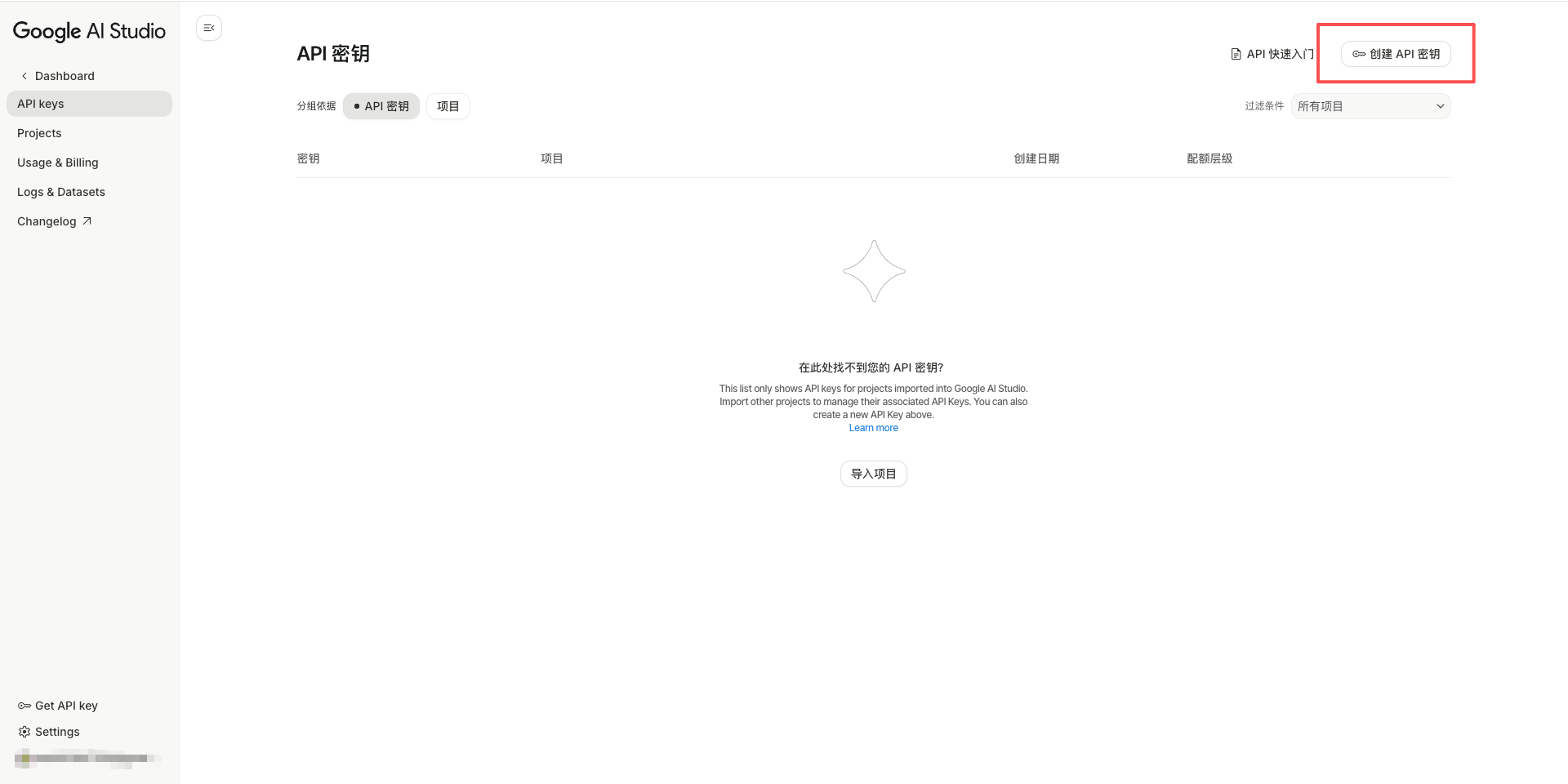

1.3 建立新的 API Key

點選 Create API key 按鈕。

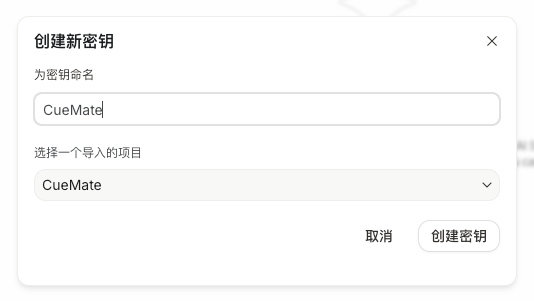

1.4 選擇 Google Cloud 專案

在彈出的對話方塊中:

- 選擇現有專案或建立新專案

- 點選 Create API key in existing project 或 Create API key in new project

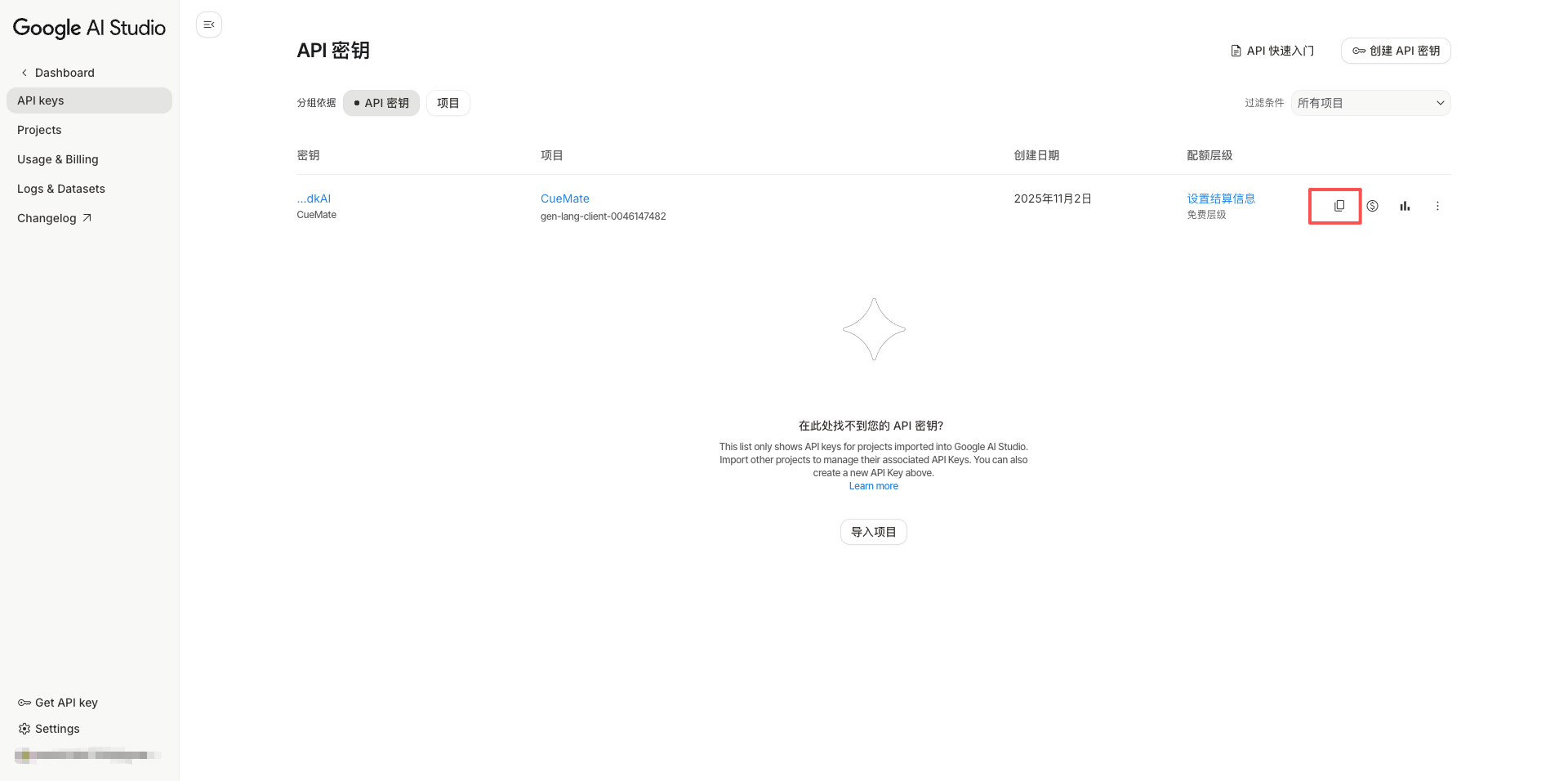

1.5 複製 API Key

建立成功後,系統會顯示 API Key。

重要:請立即複製並妥善儲存,API Key 以 AIzaSy 開頭,長度為39位字元。

點選複製按鈕,API Key 已複製到剪貼簿。

2. 在 CueMate 中配置 Gemini 模型

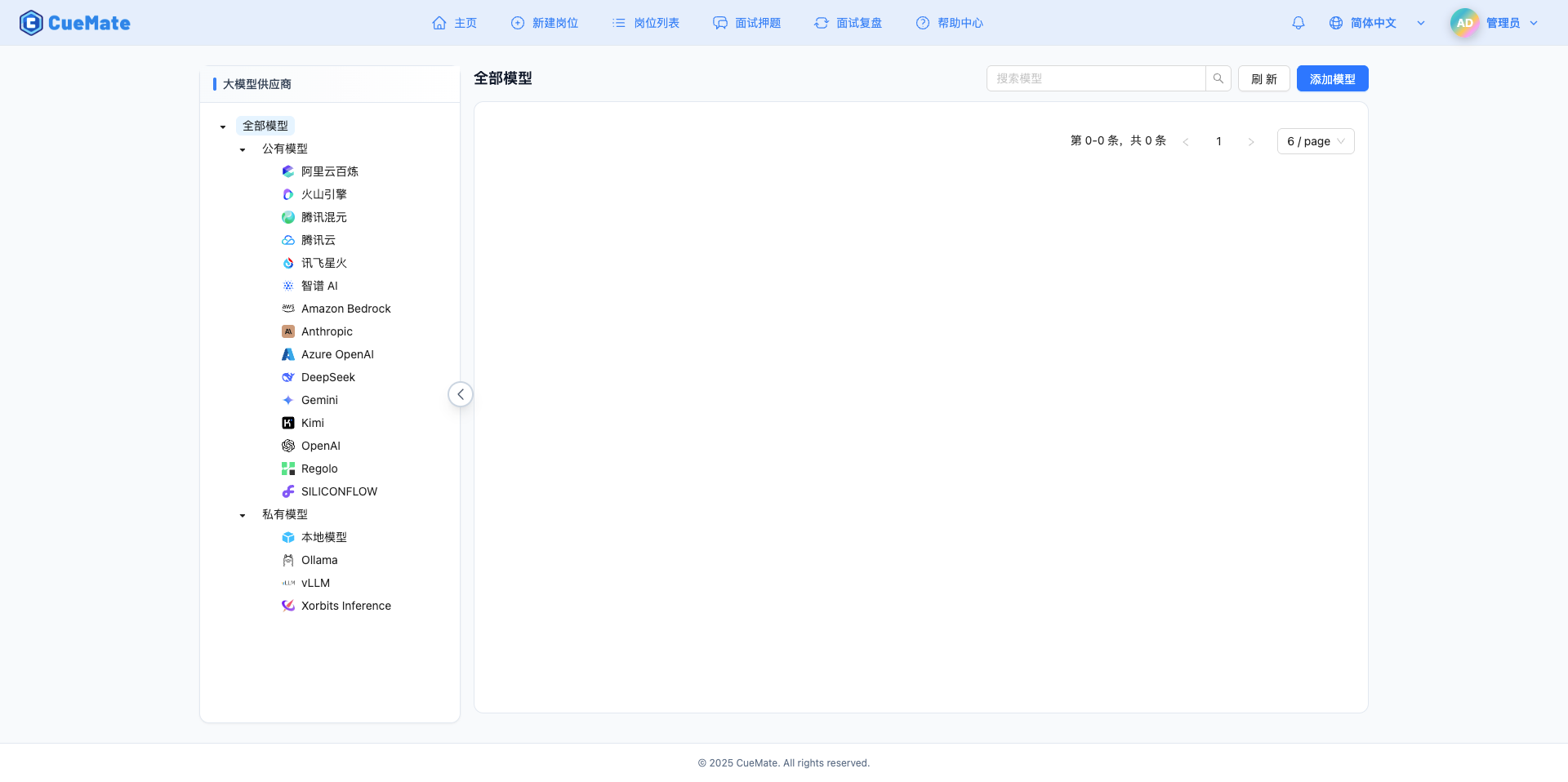

2.1 進入模型設定頁面

登入 CueMate 系統後,點選右上角下拉選單的 模型設定。

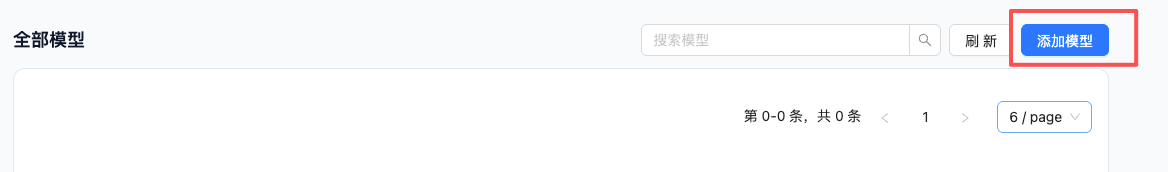

2.2 新增新模型

點選右上角的 新增模型 按鈕。

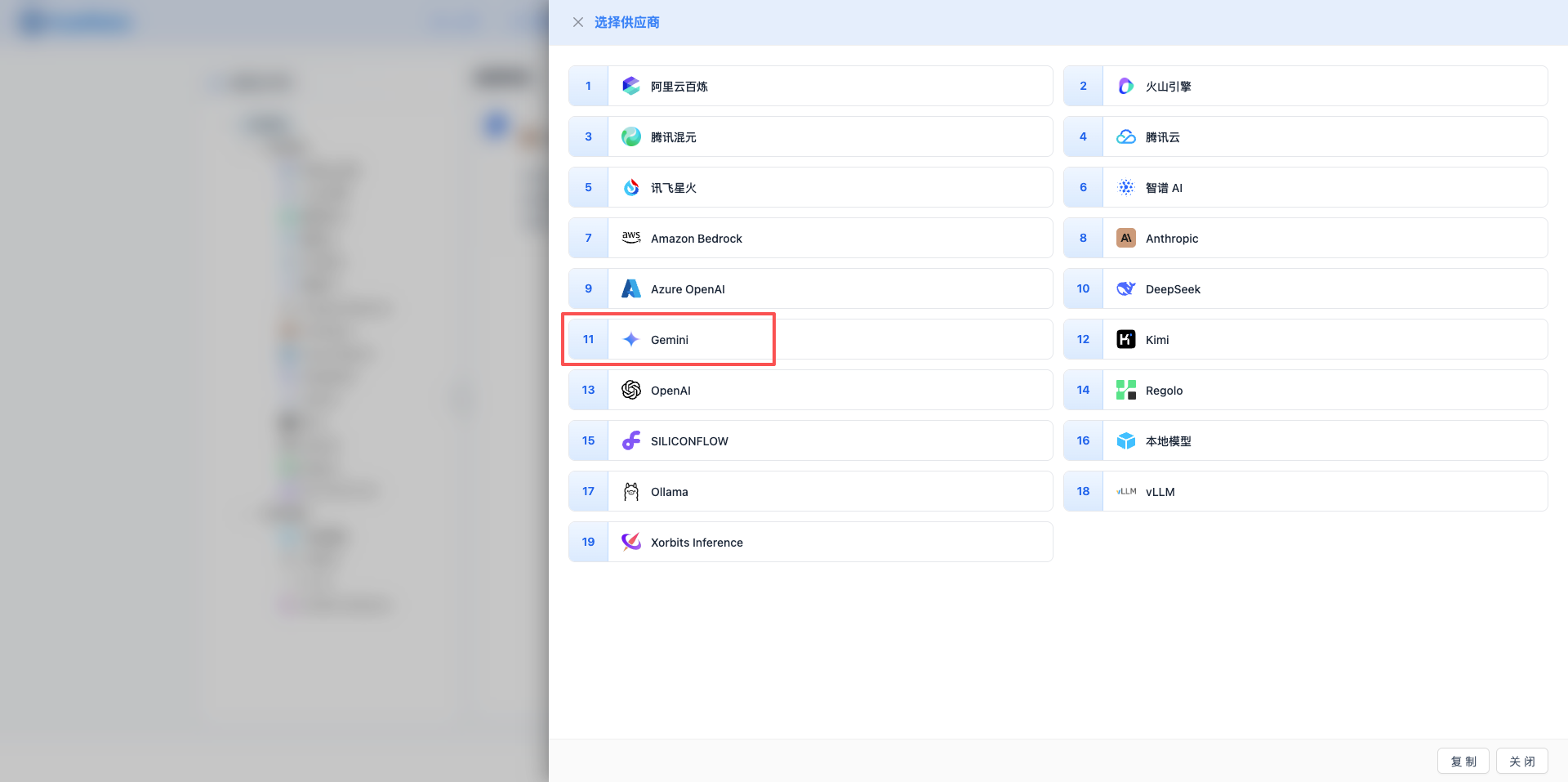

2.3 選擇 Gemini 服務商

在彈出的對話方塊中:

- 服務商型別:選擇 Gemini

- 點選後 自動進入下一步

2.4 填寫配置資訊

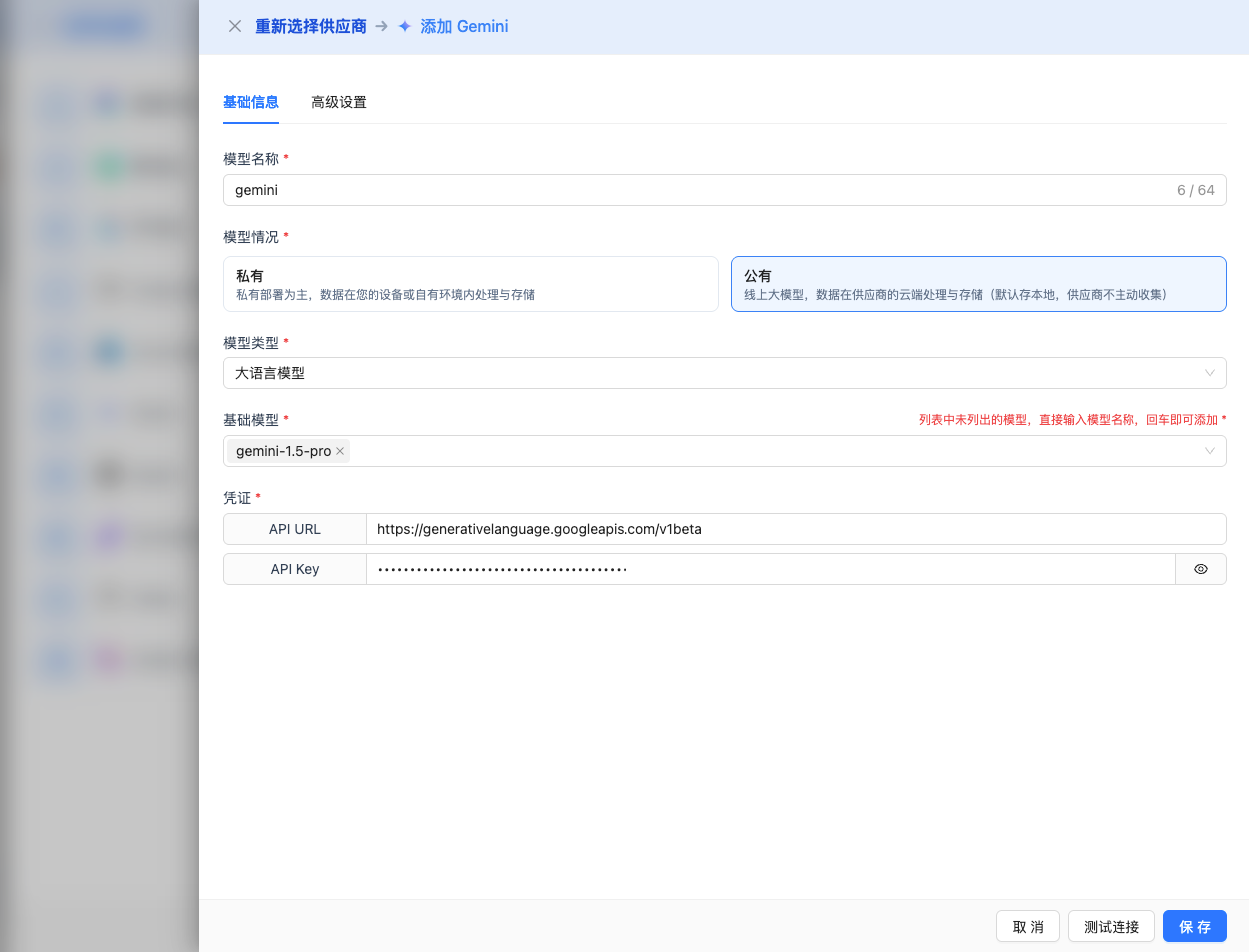

在配置頁面填寫以下資訊:

基礎配置

- 模型名稱:為這個模型配置起個名字(例如:Gemini-2.0-Flash)

- API Key:貼上剛才複製的Google Gemini API Key

- API URL:保持預設

https://generativelanguage.googleapis.com/v1beta - 模型版本:選擇或輸入要使用的模型(推薦使用完整版本號)

gemini-2.5-pro-exp-03-25:2.5 Pro實驗版,最強效能gemini-2.0-flash-001:2.0 Flash穩定版,推薦使用gemini-2.0-flash-exp:2.0 Flash實驗版gemini-1.5-pro-latest:1.5 Pro最新版gemini-1.5-pro-002:1.5 Pro穩定版gemini-1.5-flash-latest:1.5 Flash最新版gemini-1.5-flash-002:1.5 Flash穩定版gemini-1.5-flash-8b:8B引數輕量版gemini-1.0-pro:1.0 Pro標準版(舊版)gemini-1.0-pro-vision:1.0 支援視覺理解(舊版)

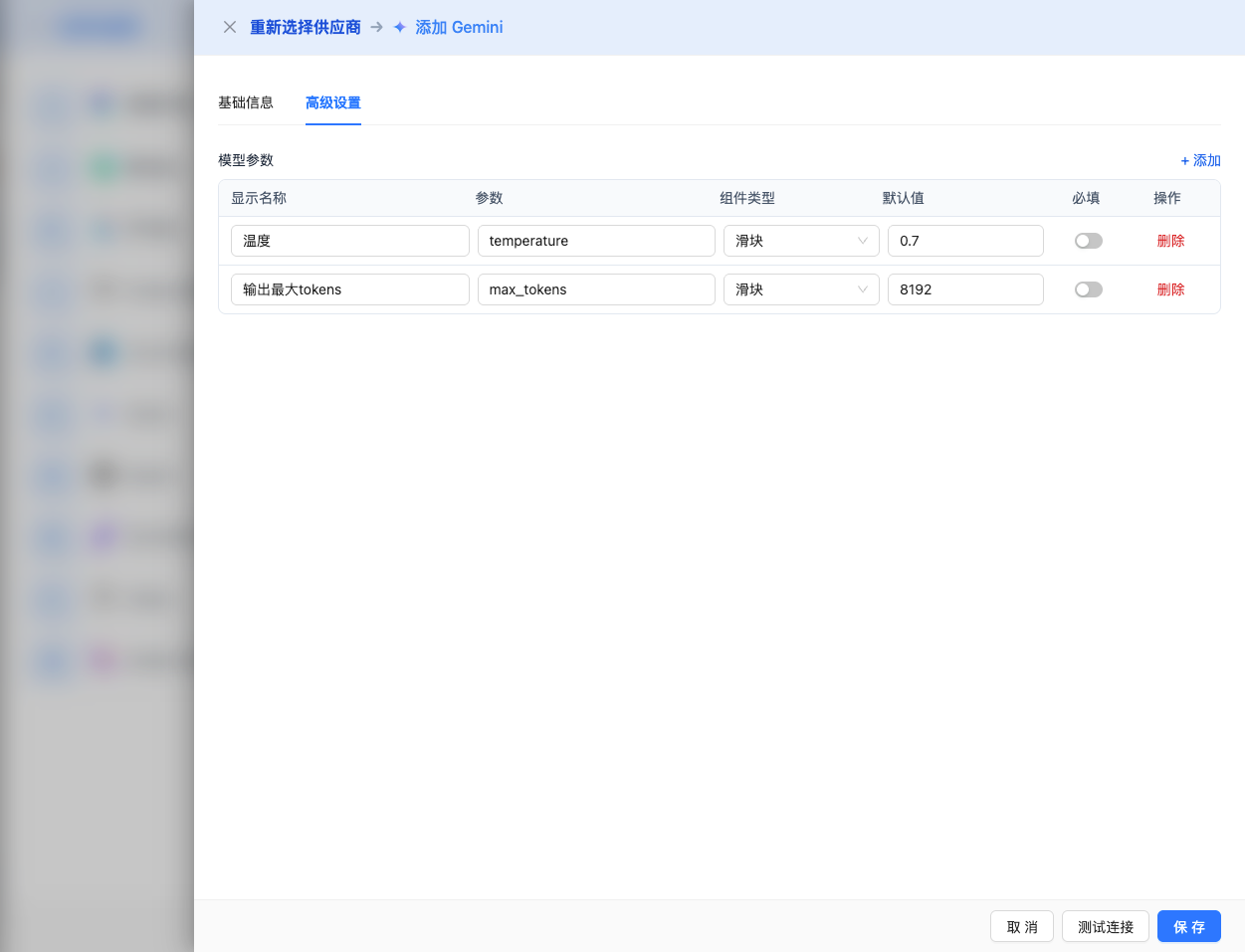

高階配置(可選)

展開 高階配置 面板,可以調整以下引數:

CueMate 介面可調引數:

溫度(temperature):控制輸出隨機性

- 範圍:0-2

- 推薦值:0.7

- 作用:值越高輸出越隨機創新,值越低輸出越穩定保守

- 使用建議:

- 創意寫作/頭腦風暴:1.0-1.5

- 常規對話/問答:0.7-0.9

- 程式碼生成/精確任務:0.3-0.5

- 注意:Gemini 的 temperature 範圍是 0-2,與 Claude 的 0-1 不同

輸出最大 tokens(maxOutputTokens):限制單次輸出長度

- 範圍:256 - 65536(根據模型而定)

- 推薦值:8192

- 作用:控制模型單次響應的最大字數

- 模型限制:

- Gemini 2.5 Pro:最大 65K tokens

- Gemini 2.0 系列:最大 8K tokens

- Gemini 1.5 系列:最大 8K tokens

- Gemini 1.0 Pro:最大 2K tokens

- Gemini 1.0 Pro Vision:最大 4K tokens

- 使用建議:

- 簡短問答:1024-2048

- 常規對話:4096-8192

- 長文生成:16384-32768

- 超長輸出:65536(僅 2.5 Pro)

Google Gemini API 支援的其他高階引數:

雖然 CueMate 介面只提供 temperature 和 maxOutputTokens 調整,但如果你透過 API 直接呼叫 Gemini,還可以使用以下高階引數:

topP(nucleus sampling)

- 範圍:0-1

- 預設值:0.95

- 作用:從機率累積達到 p 的最小候選集中取樣

- 與 temperature 的關係:可以同時使用

- 使用建議:

- 保持多樣性:0.9-1.0

- 更保守的輸出:0.7-0.8

topK

- 範圍:1-40

- 預設值:40(或 null,表示不限制)

- 作用:從機率最高的 k 個候選詞中取樣

- 使用建議:

- 更多樣化:32-40

- 更保守:10-20

- 注意:Gemini 的 topK 最大值為 40

stopSequences(停止序列)

- 型別:字串陣列

- 預設值:null

- 最大數量:5 個字串

- 作用:當生成內容包含指定字串時停止

- 示例:

["END", "###", "\n\n"] - 使用場景:

- 結構化輸出:使用分隔符控制格式

- 對話系統:防止模型繼續生成

- 程式碼塊控制:使用程式碼塊結束標記

candidateCount

- 型別:整數

- 範圍:1-8

- 預設值:1

- 作用:生成多個候選回覆供選擇

- 使用場景:

- A/B 測試不同輸出

- 選擇最佳回覆

- 注意:會增加 API 呼叫成本

Gemini 安全設定:

- safetySettings

- 型別:物件陣列

- 作用:配置內容安全過濾級別

- 安全類別:

HARM_CATEGORY_HARASSMENT:騷擾內容HARM_CATEGORY_HATE_SPEECH:仇恨言論HARM_CATEGORY_SEXUALLY_EXPLICIT:性相關內容HARM_CATEGORY_DANGEROUS_CONTENT:危險內容

- 過濾級別:

BLOCK_NONE:不過濾BLOCK_LOW_AND_ABOVE:過濾低風險及以上BLOCK_MEDIUM_AND_ABOVE:過濾中等及以上(預設)BLOCK_ONLY_HIGH:僅過濾高風險

- 示例:json

{ "safetySettings": [ { "category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_MEDIUM_AND_ABOVE" } ] } - 使用建議:

- 面向公眾的應用:保持預設設定

- 內部工具/研究:可適當放寬(BLOCK_ONLY_HIGH)

- 嚴格場景:使用 BLOCK_LOW_AND_ABOVE

| 場景 | temperature | maxOutputTokens | topP | topK | stopSequences |

|---|---|---|---|---|---|

| 創意寫作 | 1.0-1.2 | 4096-8192 | 0.95 | 40 | null |

| 程式碼生成 | 0.2-0.5 | 2048-4096 | 0.9 | 30 | null |

| 問答系統 | 0.7 | 1024-2048 | 0.9 | 40 | null |

| 摘要總結 | 0.3-0.5 | 512-1024 | 0.9 | 20 | null |

| 結構化輸出 | 0.5 | 2048 | 0.9 | 30 | ["END", "###"] |

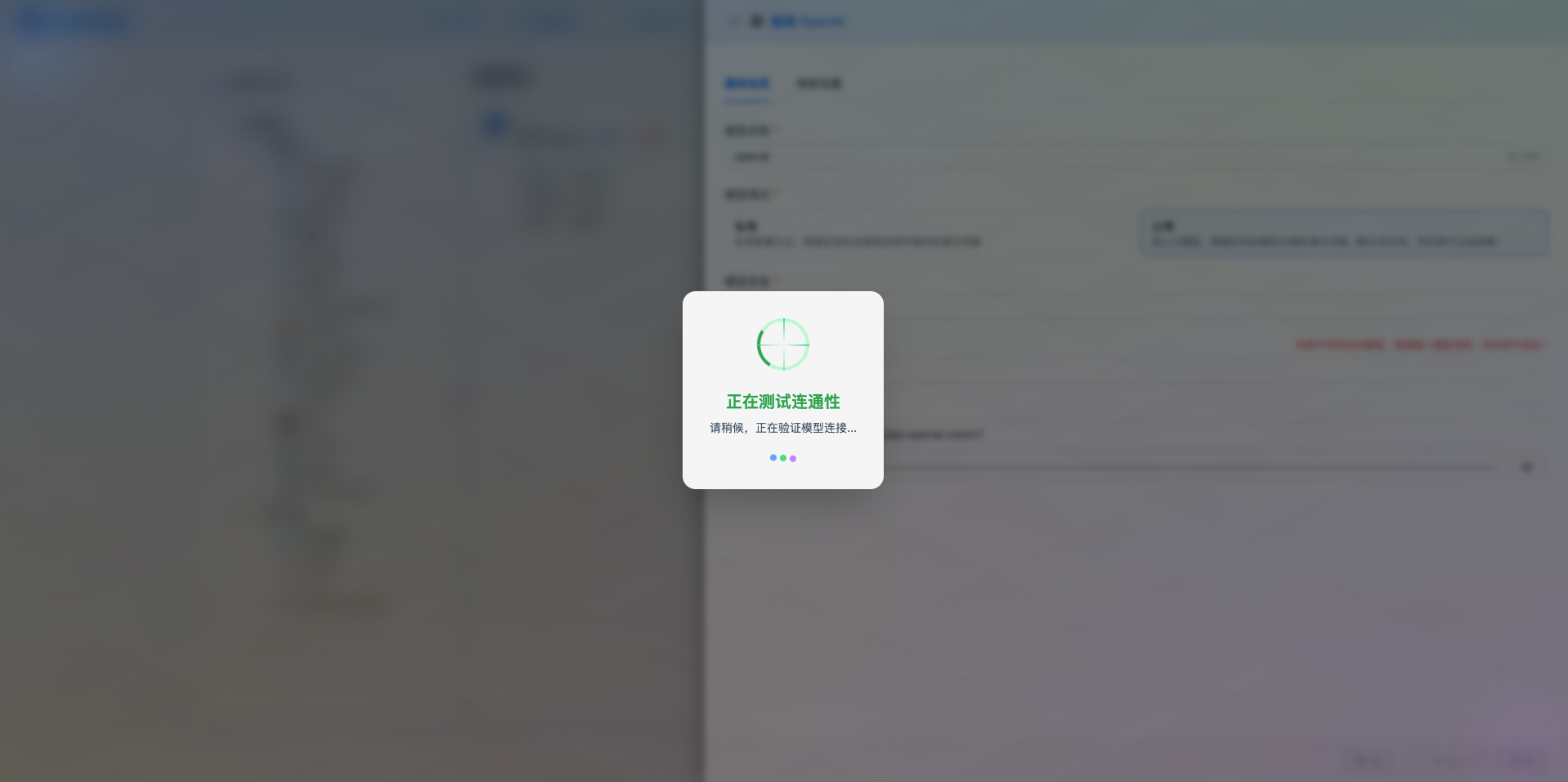

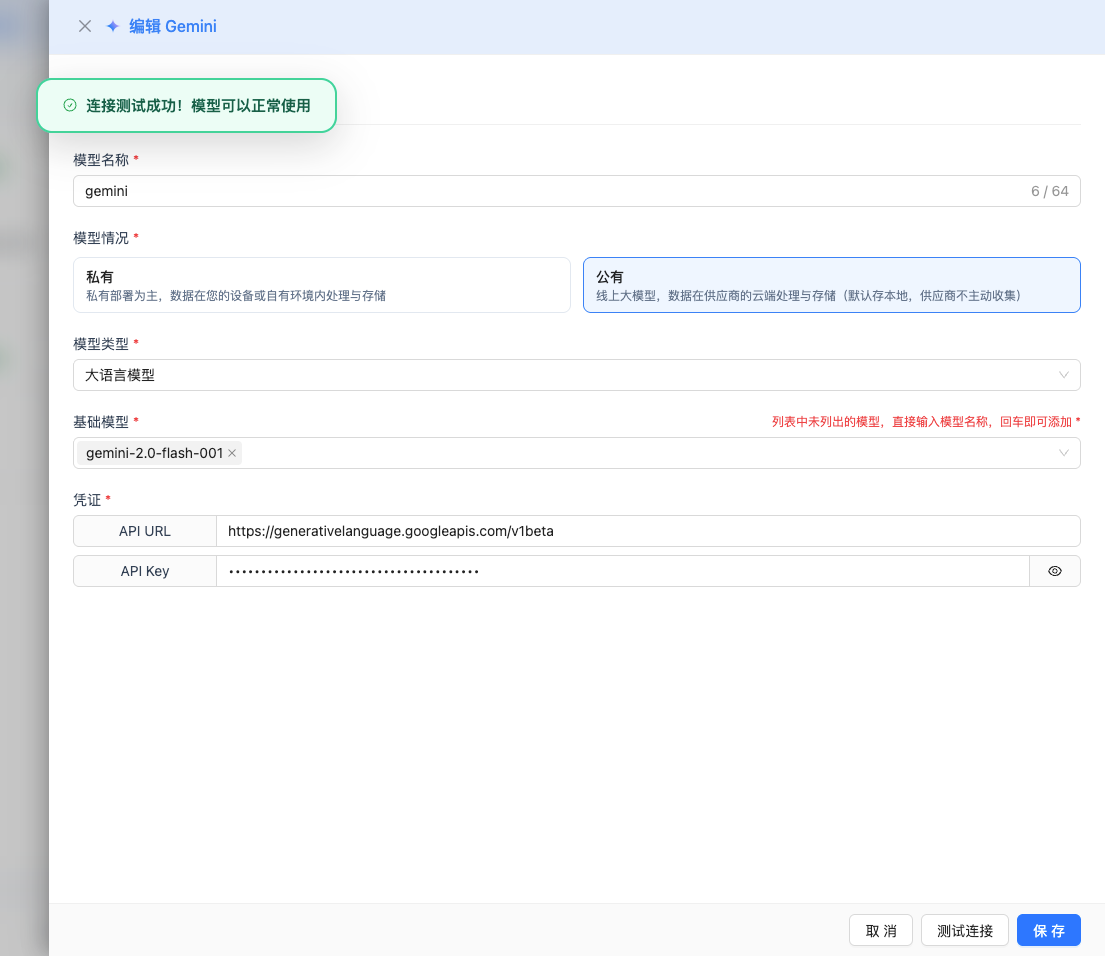

2.5 測試連線

填寫完配置後,點選 測試連線 按鈕,驗證配置是否正確。

如果配置正確,會顯示測試成功的提示,並返回模型的響應示例。

如果配置錯誤,會顯示測試錯誤的日誌,並且可以透過日誌管理,檢視具體報錯資訊。

2.6 儲存配置

測試成功後,點選 儲存 按鈕,完成模型配置。

3. 使用模型

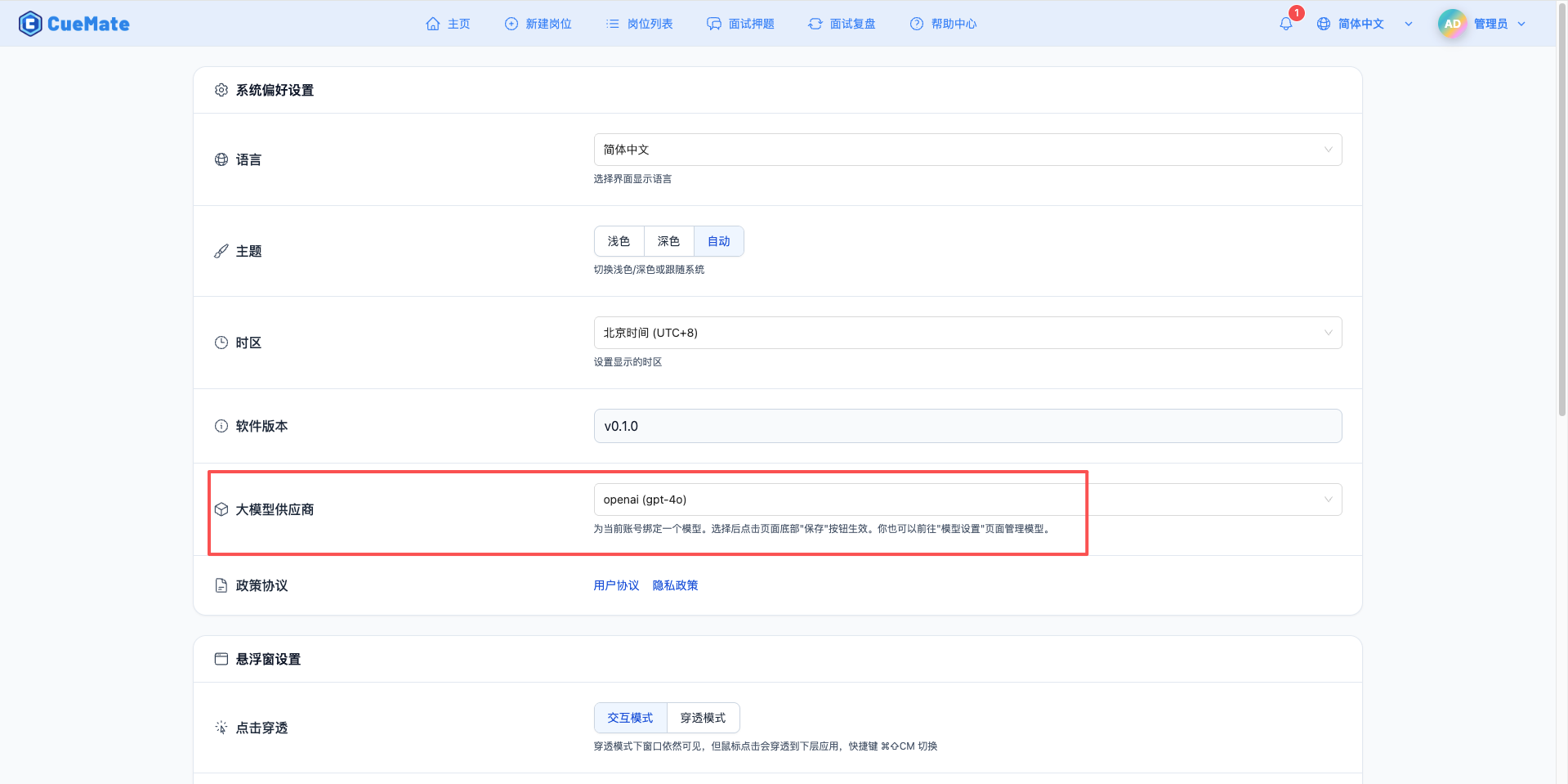

透過右上角下拉選單,進入系統設定介面,在大模型服務商欄目選擇想要使用的模型配置。

配置完成後,可以在面試訓練、問題生成等功能中選擇使用此模型, 當然也可以在面試的選項中單此選擇此次面試的模型配置。

4. 支援的模型列表

4.1 Gemini 2.5 系列(2026 最新)

| 序號 | 模型名稱 | 模型 ID | 最大輸出 | 適用場景 |

|---|---|---|---|---|

| 1 | Gemini 2.5 Pro (實驗) | gemini-2.5-pro-exp-03-25 | 65K tokens | 最強效能、長文字生成 |

4.2 Gemini 2.0 系列

| 序號 | 模型名稱 | 模型 ID | 最大輸出 | 適用場景 |

|---|---|---|---|---|

| 1 | Gemini 2.0 Flash | gemini-2.0-flash-001 | 8K tokens | 推薦使用、穩定版本 |

| 2 | Gemini 2.0 Flash (實驗) | gemini-2.0-flash-exp | 8K tokens | 實驗性功能測試 |

4.3 Gemini 1.5 系列

| 序號 | 模型名稱 | 模型 ID | 最大輸出 | 適用場景 |

|---|---|---|---|---|

| 1 | Gemini 1.5 Pro (最新) | gemini-1.5-pro-latest | 8K tokens | 自動使用最新版本 |

| 2 | Gemini 1.5 Pro 002 | gemini-1.5-pro-002 | 8K tokens | 複雜推理、技術面試 |

| 3 | Gemini 1.5 Flash (最新) | gemini-1.5-flash-latest | 8K tokens | 自動使用最新版本 |

| 4 | Gemini 1.5 Flash 002 | gemini-1.5-flash-002 | 8K tokens | 快速響應、常規對話 |

| 5 | Gemini 1.5 Flash 8B | gemini-1.5-flash-8b | 8K tokens | 輕量級任務、低成本 |

4.4 Gemini 1.0 系列(舊版)

| 序號 | 模型名稱 | 模型 ID | 最大輸出 | 適用場景 |

|---|---|---|---|---|

| 1 | Gemini 1.0 Pro | gemini-1.0-pro | 2K tokens | 基礎對話 |

| 2 | Gemini 1.0 Pro Vision | gemini-1.0-pro-vision | 4K tokens | 影象理解、多模態 |

4.5 推薦選擇

- 生產環境:

gemini-2.0-flash-001(穩定、高價效比) - 長文字生成:

gemini-2.5-pro-exp-03-25(最大 65K 輸出) - 快速響應:

gemini-1.5-flash-002(低延遲) - 輕量級應用:

gemini-1.5-flash-8b(最低成本)

5. 常見問題

5.1 模型名稱不存在(404 錯誤)

現象:測試連線時提示 models/gemini-1.5-pro is not found for API version v1beta

解決方案:

- 檢查模型名稱是否使用完整版本號

- 錯誤示例:

gemini-1.5-pro(不帶版本號,會返回 404) - 正確示例:

gemini-2.0-flash-001(推薦)gemini-1.5-pro-002gemini-1.5-flash-002gemini-1.5-pro-latest(使用 latest 別名)

- 不要使用簡短別名如

gemini-1.5-pro或gemini-1.5-flash,必須使用完整版本號

5.2 API Key 無效

現象:測試連線時提示 API Key 錯誤

解決方案:

- 檢查 API Key 是否以

AIzaSy開頭 - 確認 API Key 長度為 39 位字元

- 檢查 Google Cloud 專案是否啟用了 Generative Language API

- 確認 API Key 未被限制或禁用

5.3 請求超時

現象:測試連線或使用時長時間無響應

解決方案:

- 檢查網路連線是否正常

- 如果在國內,可能需要使用代理

- 檢查防火牆設定

5.4 配額不足

現象:提示配額已用完或請求頻率過高

解決方案:

- 登入 Google Cloud Console 檢視配額使用情況

- 申請提高配額限制

- 最佳化使用頻率

5.5 API 未啟用

現象:提示 API 未啟用或專案無許可權

解決方案:

- 訪問 Google Cloud Console

- 啟用 Generative Language API

- 確認專案配置正確

5.6 無法訪問 AI Studio(許可權拒絕)

現象:點選"獲取 API 金鑰"後直接報錯 "permission denied" 並跳轉到文件頁面

解決方案:

- IP 地區限制:AI Studio 對某些地區有訪問限制,需要使用美國等支援地區的代理

- 繞過 AI Studio 建立 API Key:

- 訪問 Google Cloud Console - 憑據頁面

- 點選"建立憑據" → "API 金鑰"

- 複製生成的 API Key(以

AIzaSy開頭) - 在"API 限制"中選擇"Generative Language API"

- 說明:透過 Cloud Console 建立的 API Key 與 AI Studio 建立的完全相同,可以正常使用